L’Istituto di Fisica Applicata “Nello Carrara” (IFAC) è parte del Consiglio Nazionale delle Ricerche (CNR) il principale ente pubblico che persegue in Italia obiettivi di ricerca ed innovazione.

IFAC è il maggiore istituto dell’Area di Ricerca CNR di Firenze, presso il Polo Scientifico di Sesto Fiorentino e conduce attività di ricerca, sviluppo sperimentale e trasferimento tecnologico in molte aree della Fisica Applicata e dell’ICT.

News

PhotonHub Demo Center: “Fundamentals, fabrication and characterisation techniques of guided optical systems”

The Institute of applied physics "Nello Carrara" (Cnr-Ifac) organizes a one-day training course as part of the European photonics innovation hub "Photon Hub Europe". PhotonHub Europe acts as a one-stop-shop matchmaker...

L’intelligenza artificiale nel mondo dei beni culturali: un dialogo tra tecnologia, patrimonio e riflessioni filosofiche

Il 27/04/2024 ore 16.30 - 18.00 Firenze, Fortezza da Basso, Quartieri Monumentali, Sala Sottani Mentre l’IA è ormai parte integrante di molti settori delle scienze e sta allo stesso tempo...

Avviso di Cessione Gratuita di beni mobili fuori uso

Il Direttore, effettuata la ricognizione di tutti i beni mobili in carico all’Istituto, accertata in loco le caratteristiche degli stessi che ne consentono la dismissione, ha dichiarato con documento prot....

Workshop – Lo spazio europeo dei dati sanitari nell’era dell’AI: Infrastrutture, dati, utenti

11 aprile 2024 | ore 11.00 -13.00 Aula 1 Marconi | Area di Ricerca di Firenze CNR Con la partecipazione del prof. Ricard Martínez Martínez, Università Valencia, Direttore Cattedra Microsoft...

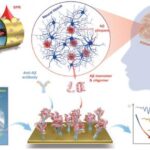

Alzheimer, sviluppato un sistema di sensing avanzato in fibra ottica per il rilevamento simultaneo e discriminazione di biomarcatori clinici della malattia

Con il graduale invecchiamento della popolazione, la prevalenza mondiale della malattia dell'Alzheimer, come demenza più comune negli anziani, sta aumentando drammaticamente. Tuttavia, una sfida a lungo termine - e tutt'ora...

Indagini georadar per portare alla luce una balenottera di mille anni fa

Sono iniziate le indagini con il georadar per portare alla luce lo scheletro di un cetaceo individuato a Viareggio (Lucca) a 2 km dalla costa. I primi resti, 4 enormi...